Categorias crianças

27. Monitoramento Biológico (6)

27. Monitoramento Biológico

Editor do Capítulo: Robert Lauwerys

Conteúdo

Tabelas e Figuras

Princípios gerais

Vito Foà e Lorenzo Alessio

Garantia da Qualidade

D. Gompertz

Metais e Compostos Organometálicos

P. Hoet e Robert Lauwerys

Solventes orgânicos

Masayuki Ikeda

Químicos Genotóxicos

marja sorsa

Pesticidas

Marco Maroni e Adalberto Ferioli

Tabelas

Clique em um link abaixo para ver a tabela no contexto do artigo.

1. ACGIH, DFG e outros valores limite para metais

2. Exemplos de produtos químicos e monitoramento biológico

3. Monitoramento biológico para solventes orgânicos

4. Genotoxicidade de produtos químicos avaliados pela IARC

5. Biomarcadores e algumas amostras de células/tecidos e genotoxicidade

6. Carcinógenos humanos, exposição ocupacional e pontos finais citogenéticos

8. Exposição da produção e uso de pesticidas

9. Toxicidade aguda de OP em diferentes níveis de inibição de ACHE

10. Variações de DOR e PCHE e condições de saúde selecionadas

11. Atividades da colinesterase de pessoas saudáveis não expostas

12. Fosfatos de alquil urinários e pesticidas OP

13. Medições de alquil fosfatos urinários e OP

14. Metabólitos de carbamato urinário

15. Metabólitos de ditiocarbamato urinário

16. Índices propostos para monitoramento biológico de agrotóxicos

17. Valores-limite biológicos recomendados (a partir de 1996)

figuras

Aponte para uma miniatura para ver a legenda da figura, clique para ver a figura no contexto do artigo.

28. Epidemiologia e Estatística (12)

28. Epidemiologia e Estatística

Editores de Capítulo: Franco Merletti, Colin L. Soskolne e Paolo Vineis

Conteúdo

Tabelas e Figuras

Método Epidemiológico Aplicado à Saúde e Segurança Ocupacional

Franco Merletti, Colin L. Soskolne e Paolo Vineis

Avaliação de exposição

M. Gerald Ott

Medidas resumidas de exposição na vida profissional

Colin L. Soskolne

Medindo os efeitos das exposições

Shelia Hoar Zahm

Estudo de Caso: Medidas

Franco Merletti, Colin L. Soskolne e Paola Vineis

Opções no Projeto de Estudo

Sven Hernberg

Questões de validade no desenho do estudo

Annie J. Sasco

Impacto do erro de medição aleatória

Paolo Vineis e Colin L. Soskolne

Métodos estatísticos

Annibale Biggeri e Mário Braga

Avaliação de causalidade e ética na pesquisa epidemiológica

Paulo Vineis

Estudos de Caso Ilustrando Questões Metodológicas na Vigilância de Doenças Profissionais

Jung-Der Wang

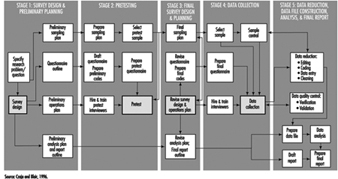

Questionários em Pesquisa Epidemiológica

Steven D. Stellman e Colin L. Soskolne

Perspectiva Histórica do Amianto

Lawrence Garfinkel

Tabelas

Clique em um link abaixo para ver a tabela no contexto do artigo.

1. Cinco medidas resumidas selecionadas de exposição na vida profissional

2. Medidas de ocorrência da doença

3. Medidas de associação para um estudo de coorte

4. Medidas de associação para estudos de caso-controle

5. Layout geral da tabela de frequência para dados de coorte

6. Exemplo de layout de dados de controle de caso

7. Dados de controle de caso de layout - um controle por caso

8. Coorte hipotética de 1950 indivíduos para T2

9. Índices de tendência central e dispersão

10. Um experimento binomial e probabilidades

11. Possíveis resultados de um experimento binomial

12. Distribuição binomial, 15 sucessos/30 tentativas

13. Distribuição binomial, p = 0.25; 30 tentativas

14. Erro e potência tipo II; x = 12, n = 30, a = 0.05

15. Erro e potência tipo II; x = 12, n = 40, a = 0.05

16. 632 trabalhadores expostos ao amianto por 20 anos ou mais

17. O/E número de mortes entre 632 trabalhadores do amianto

figuras

Aponte para uma miniatura para ver a legenda da figura, clique para ver a figura no contexto do artigo.

29. Ergonomia (27)

29. Ergonomia

Editores de Capítulo: Wolfgang Laurig e Joachim Vedder

Conteúdo

Tabelas e Figuras

Visão geral

Wolfgang Laurig e Joachim Vedder

Objetivos, Princípios e Métodos

A natureza e os objetivos da ergonomia

William T.Singleton

Análise de Atividades, Tarefas e Sistemas de Trabalho

Véronique De Keyser

Ergonomia e Padronização

Friedhelm Nachreiner

Lista de verificação

Pranab Kumar Nag

Aspectos Físicos e Fisiológicos

Antropometria

Melchiorre Masali

trabalho muscular

Juhani Smolander e Veikko Louhevaara

Posturas no Trabalho

Ilkka Kuorinka

Biomecânica

Frank darby

Fadiga Geral

Étienne Grandjean

Fadiga e Recuperação

Rolf Helbig e Walter Rohmert

Aspectos psicológicos

carga de trabalho mental

Hacker Winfried

vigilância

Herbert Heuer

Fadiga mental

Pedro Richter

Aspectos Organizacionais do Trabalho

Organização do Trabalho

Eberhard Ulich e Gudela Grote

Privação de sono

Kazutaka Kogi

Projeto de sistemas de trabalho

workstations

Roland Kadefors

Ferramentas

TM Fraser

Controles, Indicadores e Painéis

Karl HE Kroemer

Processamento e Design de Informação

Andries F. Sanders

Projetando para todos

Projetando para grupos específicos

Piada H. Grady-van den Nieuwboer

Estudo de Caso: A Classificação Internacional de Limitação Funcional em Pessoas

Diferenças culturais

Houshang Shahnavaz

Trabalhadores Idosos

Antoine Laville e Serge Volkoff

Trabalhadores com Necessidades Especiais

Piada H. Grady-van den Nieuwboer

Diversidade e importância da ergonomia - dois exemplos

Projeto de sistema na fabricação de diamantes

Issacar Gilad

Desconsiderando os princípios de design ergonômico: Chernobyl

Vladimir M. Munipov

Tabelas

Clique em um link abaixo para ver a tabela no contexto do artigo.

1. Lista central antropométrica básica

2. Fadiga e recuperação dependentes dos níveis de atividade

3. Regras de efeitos de combinação de dois fatores de tensão na deformação

4. Diferenciando entre várias consequências negativas da tensão mental

5. Princípios orientados ao trabalho para a estruturação da produção

6. Participação no contexto organizacional

7. Participação do usuário no processo de tecnologia

8. Jornada de trabalho irregular e privação de sono

9. Aspectos do sono de avanço, âncora e retardo

10. Movimentos de controle e efeitos esperados

11. Relações controle-efeito de controles manuais comuns

12. Regras para arranjo de controles

figuras

Aponte para uma miniatura para ver a legenda da figura, clique para ver a figura no contexto do artigo.

30. Higiene Ocupacional (6)

30. Higiene Ocupacional

Editor de Capítulo: Robert F. Herrick

Conteúdo

Tabelas e Figuras

Objetivos, Definições e Informações Gerais

Berenice I. Ferrari Goelzer

Reconhecimento de perigos

Linnea Lillienberg

Avaliação do Ambiente de Trabalho

Lori A. Todd

Higiene Ocupacional: Controle de Exposições por Intervenção

James Stewart

A base biológica para avaliação de exposição

Dick Heederik

limites de exposição ocupacional

Dennis J. Paustenbach

Tabelas

1. Perigos de produtos químicos; agentes biológicos e físicos

2. Limites de exposição ocupacional (OELs) - vários países

figuras

31. Proteção Pessoal (7)

31. Proteção Pessoal

Editor de Capítulo: Robert F. Herrick

Conteúdo

Tabelas e Figuras

Visão geral e filosofia de proteção pessoal

Robert F. Herrick

Protetores oculares e faciais

Kikuzi Kimura

Proteção para Pés e Pernas

Toyohiko Miura

Proteção de cabeça

Isabelle Balty e Alain Mayer

Proteção auditiva

John R. Franks e Elliott H. Berger

Roupa de proteção

S. Zack Mansdorf

Proteção respiratória

Thomas J Nelson

Tabelas

Clique em um link abaixo para visualizar a tabela no contexto do artigo.

1. Requisitos de transmissão (ISO 4850-1979)

2. Escalas de proteção - soldagem a gás e soldagem por brasagem

3. Escalas de proteção - corte de oxigênio

4. Escalas de proteção - corte a arco de plasma

5. Escalas de proteção - soldagem a arco elétrico ou goivagem

6. Escalas de proteção - soldagem a arco plasma direta

7. Capacete de segurança: Norma ISO 3873-1977

8. Classificação de redução de ruído de um protetor auditivo

9. Calculando a redução de ruído ponderada A

10. Exemplos de categorias de perigo dérmico

11. Requisitos de desempenho físico, químico e biológico

12. Perigos materiais associados a atividades específicas

13. Fatores de proteção atribuídos de ANSI Z88 2 (1992)

figuras

Aponte para uma miniatura para ver a legenda da figura, clique para ver a figura no contexto do artigo.

32. Sistemas de Registro e Vigilância (9)

32. Sistemas de Registro e Vigilância

Editor de Capítulo: Steven D. Stellman

Conteúdo

Tabelas e Figuras

Sistemas de Vigilância e Notificação de Doenças Ocupacionais

Steven B. Markowitz

Vigilância de Riscos Ocupacionais

David H. Wegman e Steven D. Stellman

Vigilância em países em desenvolvimento

David Koh e Kee-Seng Chia

Desenvolvimento e Aplicação de um Sistema de Classificação de Lesões e Doenças Ocupacionais

Elyce Biddle

Análise de risco de lesões e doenças não fatais no local de trabalho

John W. Ruser

Estudo de Caso: Proteção ao Trabalhador e Estatísticas de Acidentes e Doenças Profissionais - HVBG, Alemanha

Martin Butz e Burkhard Hoffmann

Estudo de caso: Wismut - uma exposição de urânio revisitada

Heinz Otten e Horst Schulz

Estratégias e Técnicas de Medição para Avaliação da Exposição Ocupacional em Epidemiologia

Frank Bochmann e Helmut Blome

Estudo de caso: pesquisas de saúde ocupacional na China

Tabelas

Clique em um link abaixo para visualizar a tabela no contexto do artigo.

1. Angiossarcoma do fígado - registro mundial

2. Doença ocupacional, EUA, 1986 versus 1992

3. Mortes nos EUA por pneumoconiose e mesotelioma pleural

4. Exemplo de lista de doenças ocupacionais de notificação obrigatória

5. Estrutura do código de relatórios de doenças e lesões, EUA

6. Lesões e doenças ocupacionais não fatais, EUA 1993

7. Risco de lesões e doenças ocupacionais

8. Risco relativo para condições de movimento repetitivo

9. Acidentes de trabalho, Alemanha, 1981-93

10. Retificadores em acidentes de trabalho em metal, Alemanha, 1984-93

11. Doença ocupacional, Alemanha, 1980-93

12. Doenças infecciosas, Alemanha, 1980-93

13. Exposição à radiação nas minas de Wismut

14. Doenças ocupacionais nas minas de urânio de Wismut 1952-90

figuras

Aponte para uma miniatura para ver a legenda da figura, clique para ver a figura no contexto do artigo.

33. Toxicologia (21)

33. Toxicologia

Editora do Capítulo: Ellen K. Silbergeld

Conteúdo

Tabelas e Figuras

Introdução

Ellen K. Silbergeld, Editora do Capítulo

Princípios Gerais de Toxicologia

Definições e Conceitos

Bo Holmberg, Johan Hogberg e Gunnar Johanson

Toxicocinética

Dušan Djuríc

Órgão alvo e efeitos críticos

Marek Jakubowski

Efeitos da idade, sexo e outros fatores

Spomenka Telišman

Determinantes Genéticos da Resposta Tóxica

Daniel W. Nebert e Ross A. McKinnon

Mecanismos de Toxicidade

Introdução e Conceitos

Philip G. Watanabe

Lesão celular e morte celular

Benjamin F. Trump e Irene K. Berezsky

Toxicologia Genética

R. Rita Misra e Michael P. Waalkes

Imunotoxicologia

Joseph G. Vos e Henk van Loveren

Toxicologia de órgãos-alvo

Ellen K. Silbergeld

Métodos de Teste Toxicológico

Biomarcadores

Philippe Grandjean

Avaliação de Toxicidade Genética

David M. DeMarini e James Huff

Teste de Toxicidade In Vitro

Joanne Zurlo

Relacionamentos de atividade de estrutura

Ellen K. Silbergeld

Toxicologia Regulatória

Regulação de Toxicologia em Saúde e Segurança

Ellen K. Silbergeld

Princípios de Identificação de Perigos - A Abordagem Japonesa

Masayuki Ikeda

A Abordagem dos Estados Unidos para Avaliação de Risco de Tóxicos Reprodutivos e Agentes Neurotóxicos

Ellen K. Silbergeld

Abordagens para identificação de perigos - IARC

Harri Vainio e Julian Wilbourn

Apêndice - Avaliações gerais de carcinogenicidade para humanos: IARC Monographs Volumes 1-69 (836)

Avaliação de risco cancerígeno: outras abordagens

Cees A. van der Heijden

Tabelas

Clique em um link abaixo para ver a tabela no contexto do artigo.

- Exemplos de órgãos críticos e efeitos críticos

- Efeitos básicos de possíveis interações múltiplas de metais

- Adutos de hemoglobina em trabalhadores expostos a anilina e acetanilida

- Distúrbios hereditários, propensos ao câncer e defeitos no reparo do DNA

- Exemplos de produtos químicos que exibem genotoxicidade em células humanas

- Classificação de testes para marcadores imunológicos

- Exemplos de biomarcadores de exposição

- Prós e contras de métodos para identificar riscos de câncer humano

- Comparação de sistemas in vitro para estudos de hepatotoxicidade

- Comparação de SAR e dados de teste: análises OCDE/NTP

- Regulamentação de substâncias químicas por leis, Japão

- Itens de teste sob a Lei de Controle de Substâncias Químicas, Japão

- Substâncias químicas e a Lei de Controle de Substâncias Químicas

- Principais incidentes de neurotoxicidade selecionados

- Exemplos de testes especializados para medir a neurotoxicidade

- Endpoints em toxicologia reprodutiva

- Comparação de procedimentos de extrapolação de baixa dose

- Modelos frequentemente citados na caracterização do risco cancerígeno

figuras

Aponte para uma miniatura para ver a legenda da figura, clique para ver a figura no contexto do artigo.

Fadiga Geral

Este artigo é uma adaptação da 3ª edição da Enciclopédia de Saúde e Segurança Ocupacional.

Os dois conceitos de fadiga e descanso são familiares a todos por experiência pessoal. A palavra “fadiga” é usada para denotar condições muito diferentes, que causam uma redução na capacidade de trabalho e resistência. O uso muito variado do conceito de fadiga resultou em uma confusão quase caótica e alguns esclarecimentos das idéias atuais são necessários. Por muito tempo, a fisiologia distinguiu entre fadiga muscular e fadiga geral. A primeira é um fenômeno doloroso agudo localizado nos músculos: a fadiga geral é caracterizada por uma sensação de diminuição da vontade de trabalhar. Este artigo trata apenas da fadiga geral, que também pode ser chamada de “fadiga psíquica” ou “fadiga nervosa” e o resto que ela necessita.

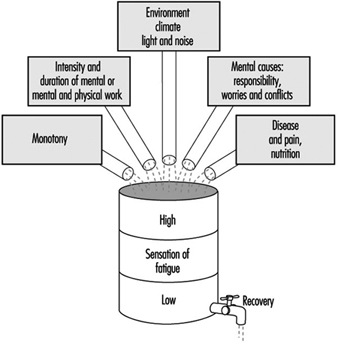

A fadiga geral pode dever-se a causas bastante diversas, das quais as mais importantes são apresentadas na figura 1. O efeito é como se, ao longo do dia, todas as várias tensões vividas se acumulassem no organismo, produzindo gradualmente uma sensação de aumento fadiga. Esse sentimento leva à decisão de interromper o trabalho; seu efeito é o de um prelúdio fisiológico para o sono.

Figura 1. Apresentação esquemática do efeito cumulativo das causas cotidianas da fadiga

A fadiga é uma sensação salutar quando se pode deitar e descansar. Porém, se a pessoa desconsidera essa sensação e se obriga a continuar trabalhando, a sensação de cansaço aumenta até se tornar angustiante e finalmente avassaladora. Esta experiência quotidiana demonstra claramente o significado biológico do cansaço que desempenha um papel na manutenção da vida, semelhante ao desempenhado por outras sensações como, por exemplo, a sede, a fome, o medo, etc.

O descanso é representado na figura 1 como o esvaziamento de um barril. O fenômeno do repouso pode ocorrer normalmente se o organismo permanecer imperturbável ou se pelo menos uma parte essencial do corpo não for submetida a estresse. Isso explica o papel decisivo desempenhado nos dias de trabalho por todas as pausas de trabalho, desde a pequena pausa durante o trabalho até o sono noturno. O símile do barril ilustra como é necessário para a vida normal atingir um certo equilíbrio entre a carga total suportada pelo organismo e a soma das possibilidades de repouso.

Interpretação neurofisiológica da fadiga

O progresso da neurofisiologia nas últimas décadas contribuiu muito para uma melhor compreensão dos fenômenos desencadeados pela fadiga no sistema nervoso central.

O fisiologista Hess foi o primeiro a observar que a estimulação elétrica de algumas estruturas diencefálicas, e mais especialmente de algumas estruturas do núcleo medial do tálamo, produzia gradualmente um efeito inibidor que se manifestava na deterioração da capacidade de reação. e com tendência a dormir. Se a estimulação continuasse por um certo tempo, o relaxamento geral era seguido por sonolência e, finalmente, pelo sono. Mais tarde foi provado que a partir dessas estruturas, uma inibição ativa pode se estender até o córtex cerebral onde se concentram todos os fenômenos conscientes. Isso se reflete não apenas no comportamento, mas também na atividade elétrica do córtex cerebral. Outros experimentos também conseguiram iniciar inibições de outras regiões subcorticais.

A conclusão que se pode tirar de todos esses estudos é que existem estruturas localizadas no diencéfalo e no mesencéfalo que representam um sistema inibidor eficaz e que desencadeiam a fadiga com todos os fenômenos que a acompanham.

Inibição e ativação

Numerosos experimentos realizados em animais e humanos mostraram que a disposição geral de ambos para a reação depende não apenas desse sistema de inibição, mas essencialmente também de um sistema que funciona de maneira antagônica, conhecido como sistema de ativação reticular ascendente. Sabemos por experimentos que a formação reticular contém estruturas que controlam o grau de vigília e, consequentemente, as disposições gerais para uma reação. Existem ligações nervosas entre essas estruturas e o córtex cerebral onde as influências ativadoras são exercidas sobre a consciência. Além disso, o sistema ativador recebe estimulação dos órgãos sensoriais. Outras conexões nervosas transmitem impulsos do córtex cerebral – a área de percepção e pensamento – para o sistema de ativação. Com base nesses conceitos neurofisiológicos, pode-se estabelecer que os estímulos externos, assim como as influências originárias das áreas da consciência, podem, ao passar pelo sistema ativador, estimular uma disposição para uma reação.

Além disso, muitas outras investigações permitem concluir que a estimulação do sistema ativador freqüentemente se espalha também dos centros vegetativos e faz com que o organismo se oriente para o gasto de energia, para o trabalho, luta, fuga, etc. (conversão ergotrópica de os órgãos internos). Inversamente, parece que a estimulação do sistema inibidor na esfera do sistema nervoso vegetativo faz com que o organismo tenda ao repouso, reconstituição de suas reservas de energia, fenômenos de assimilação (conversão trofotrópica).

Pela síntese de todos esses achados neurofisiológicos, pode-se estabelecer a seguinte concepção de fadiga: o estado e a sensação de fadiga são condicionados pela reação funcional da consciência no córtex cerebral, que é, por sua vez, regido por dois sistemas mutuamente antagônicos— o sistema inibidor e o sistema ativador. Assim, a disposição do ser humano para o trabalho depende a cada momento do grau de ativação dos dois sistemas: se o sistema inibidor for dominante, o organismo estará em estado de fadiga; quando o sistema ativador é dominante, ele exibirá uma maior disposição para o trabalho.

Esta concepção psicofisiológica da fadiga permite compreender alguns dos seus sintomas, por vezes difíceis de explicar. Assim, por exemplo, uma sensação de fadiga pode desaparecer repentinamente quando ocorre algum evento externo inesperado ou quando surge uma tensão emocional. É claro em ambos os casos que o sistema ativador foi estimulado. Inversamente, se o ambiente for monótono ou o trabalho parecer enfadonho, o funcionamento do sistema ativador é diminuído e o sistema inibidor torna-se dominante. Isso explica porque a fadiga aparece em uma situação monótona sem que o organismo seja submetido a nenhuma carga de trabalho.

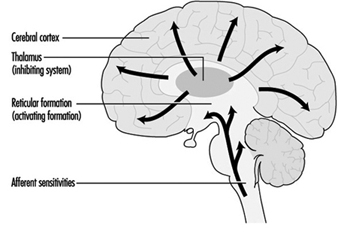

A Figura 2 representa esquematicamente a noção dos sistemas mutuamente antagônicos de inibição e ativação.

Figura 2. Apresentação esquemática do controle de disposição para o trabalho por meio de sistemas inibidores e ativadores

Fadiga clínica

É uma questão de experiência comum que a fadiga pronunciada que ocorre dia após dia produzirá gradualmente um estado de fadiga crônica. A sensação de cansaço é então intensificada e surge não só à noite, depois do trabalho, mas também durante o dia, às vezes até antes do início do trabalho. Um sentimento de mal-estar, frequentemente de natureza emotiva, acompanha este estado. Os seguintes sintomas são frequentemente observados em pessoas que sofrem de fadiga: emotividade psíquica aumentada (comportamento anti-social, incompatibilidade), tendência à depressão (ansiedade desmotivada) e falta de energia com perda de iniciativa. Estes efeitos psíquicos são frequentemente acompanhados por um mal-estar inespecífico e manifestam-se por sintomas psicossomáticos: dores de cabeça, vertigens, distúrbios funcionais cardíacos e respiratórios, perda de apetite, distúrbios digestivos, insónias, etc.

Tendo em vista a tendência a sintomas mórbidos que acompanham a fadiga crônica, pode-se chamá-la com justiça de fadiga clínica. Existe uma tendência para o aumento do absentismo e, em particular, para mais ausências por períodos curtos. Isso parece ser causado tanto pela necessidade de repouso quanto pelo aumento da morbidade. O estado de fadiga crônica ocorre particularmente entre pessoas expostas a conflitos ou dificuldades psíquicas. Às vezes é muito difícil distinguir as causas externas e internas. De fato, é quase impossível distinguir causa e efeito na fadiga clínica: uma atitude negativa em relação ao trabalho, aos superiores ou ao local de trabalho pode tanto ser a causa da fadiga clínica quanto o resultado.

A pesquisa mostrou que os operadores de central e o pessoal de supervisão empregados em serviços de telecomunicações exibiram um aumento significativo nos sintomas fisiológicos de fadiga após o trabalho (tempo de reação visual, frequência de fusão de cintilação, testes de destreza). As investigações médicas revelaram que nestes dois grupos de trabalhadoras houve um aumento significativo de quadros neuróticos, irritabilidade, dificuldade para dormir e sensação crônica de lassidão, em comparação com um grupo semelhante de mulheres empregadas nos ramos técnicos dos correios, telefone e serviços telegráficos. O acúmulo de sintomas nem sempre se deveu a uma atitude negativa por parte das mulheres que afetava seu trabalho ou suas condições de trabalho.

Medidas preventivas

Não há cura para a fadiga, mas muito pode ser feito para aliviar o problema, prestando atenção às condições gerais de trabalho e ao ambiente físico do local de trabalho. Por exemplo, muito pode ser alcançado com a organização correta das horas de trabalho, provisão de períodos de descanso adequados e cantinas e banheiros adequados; férias pagas adequadas também devem ser dadas aos trabalhadores. O estudo ergonômico do posto de trabalho também pode auxiliar na redução do cansaço ao garantir que assentos, mesas e bancadas tenham dimensões adequadas e que o fluxo de trabalho seja organizado corretamente. Além disso, controle de ruído, ar condicionado, aquecimento, ventilação e iluminação podem ter um efeito benéfico em retardar o início da fadiga nos trabalhadores.

A monotonia e a tensão também podem ser aliviadas pelo uso controlado de cores e decoração nos ambientes, intervalos de música e, às vezes, pausas para exercícios físicos para trabalhadores sedentários. A formação dos trabalhadores e, em particular, do pessoal de supervisão e de gestão também desempenha um papel importante.

Toxicologia de órgãos-alvo

O estudo e caracterização de produtos químicos e outros agentes para propriedades tóxicas é frequentemente realizado com base em órgãos e sistemas de órgãos específicos. Neste capítulo, dois alvos foram selecionados para uma discussão aprofundada: o sistema imunológico e o gene. Esses exemplos foram escolhidos para representar um sistema de órgão alvo complexo e um alvo molecular dentro das células. Para uma discussão mais abrangente da toxicologia dos órgãos-alvo, o leitor deve consultar os textos de toxicologia padrão, como Casarett e Doull e Hayes. O Programa Internacional de Segurança Química (IPCS) também publicou vários documentos de critérios sobre toxicologia de órgãos-alvo, por sistema de órgãos.

Os estudos de toxicologia de órgãos-alvo são geralmente realizados com base em informações que indicam o potencial de efeitos tóxicos específicos de uma substância, seja de dados epidemiológicos ou de estudos gerais de toxicidade aguda ou crônica, ou com base em preocupações especiais para proteger certas funções de órgãos, como como reprodução ou desenvolvimento fetal. Em alguns casos, testes específicos de toxicidade de órgãos-alvo são expressamente exigidos por autoridades estatutárias, como testes de neurotoxicidade sob a lei de pesticidas dos EUA (consulte “A abordagem dos Estados Unidos para avaliação de risco de tóxicos reprodutivos e agentes neurotóxicos” e testes de mutagenicidade sob a Norma Japonesa de Produtos Químicos). Lei de Controle de Substâncias (consulte “Princípios de identificação de perigos: A abordagem japonesa”).

Conforme discutido em “órgão-alvo e efeitos críticos”, a identificação de um órgão crítico é baseada na detecção do órgão ou sistema de órgãos que primeiro responde adversamente ou às doses ou exposições mais baixas. Esta informação é então usada para projetar investigações toxicológicas específicas ou testes de toxicidade mais definidos que são projetados para obter indicações mais sensíveis de intoxicação no órgão-alvo. Estudos de toxicologia de órgãos-alvo também podem ser usados para determinar mecanismos de ação, de uso na avaliação de risco (consulte “A abordagem dos Estados Unidos para avaliação de risco de tóxicos reprodutivos e agentes neurotóxicos”).

Métodos de estudos de toxicidade de órgãos-alvo

Os órgãos-alvo podem ser estudados pela exposição de organismos intactos e análise detalhada da função e histopatologia no órgão-alvo, ou pela exposição in vitro de células, fatias de tecido ou órgãos inteiros mantidos por períodos curtos ou longos em cultura (consulte “Mecanismos de toxicologia: Introdução e conceitos”). Em alguns casos, tecidos de seres humanos também podem estar disponíveis para estudos de toxicidade de órgãos-alvo, e isso pode fornecer oportunidades para validar suposições de extrapolação entre espécies. No entanto, deve-se ter em mente que tais estudos não fornecem informações sobre a toxicocinética relativa.

Em geral, os estudos de toxicidade de órgãos-alvo compartilham as seguintes características comuns: exame histopatológico detalhado do órgão-alvo, incluindo exame post mortem, peso do tecido e exame de tecidos fixados; estudos bioquímicos de vias críticas no órgão-alvo, como sistemas enzimáticos importantes; estudos funcionais da capacidade do órgão e constituintes celulares para realizar funções metabólicas esperadas e outras; e análise de biomarcadores de exposição e efeitos precoces em células de órgãos-alvo.

O conhecimento detalhado da fisiologia, bioquímica e biologia molecular dos órgãos-alvo pode ser incorporado aos estudos dos órgãos-alvo. Por exemplo, como a síntese e secreção de proteínas de baixo peso molecular é um aspecto importante da função renal, os estudos de nefrotoxicidade geralmente incluem atenção especial a esses parâmetros (IPCS 1991). Como a comunicação célula a célula é um processo fundamental da função do sistema nervoso, os estudos de órgãos-alvo na neurotoxicidade podem incluir medições neuroquímicas e biofísicas detalhadas da síntese, captação, armazenamento, liberação e ligação do receptor de neurotransmissores, bem como medições eletrofisiológicas de alterações na membrana potencial associado a esses eventos.

Um alto grau de ênfase está sendo colocado no desenvolvimento de métodos in vitro para toxicidade de órgãos-alvo, para substituir ou reduzir o uso de animais inteiros. Avanços substanciais nesses métodos foram alcançados para tóxicos reprodutivos (Heindel e Chapin 1993).

Em resumo, os estudos de toxicidade de órgãos-alvo são geralmente realizados como um teste de ordem superior para determinar a toxicidade. A seleção de órgãos-alvo específicos para avaliação posterior depende dos resultados dos testes de nível de triagem, como os testes agudos ou subcrônicos usados pela OCDE e pela União Européia; alguns órgãos-alvo e sistemas de órgãos podem ser candidatos a priori para investigação especial devido a preocupações de prevenir certos tipos de efeitos adversos à saúde.

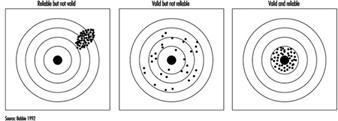

Questões de validade no desenho do estudo

A Necessidade de Validade

A epidemiologia visa fornecer uma compreensão da experiência da doença nas populações. Em particular, pode ser usado para obter informações sobre as causas ocupacionais de problemas de saúde. Esse conhecimento vem de estudos realizados em grupos de pessoas com uma doença, comparando-os com pessoas sem essa doença. Outra abordagem é examinar quais doenças as pessoas que trabalham em determinados empregos com exposições específicas adquirem e comparar esses padrões de doenças com os de pessoas não expostas de maneira semelhante. Esses estudos fornecem estimativas de risco de doença para exposições específicas. Para que as informações desses estudos possam ser utilizadas para estabelecer programas de prevenção, para o reconhecimento de doenças profissionais e para que os trabalhadores afetados por exposições sejam devidamente compensados, esses estudos devem ser válidos.

Validade pode ser definida como a capacidade de um estudo de refletir o verdadeiro estado das coisas. Um estudo válido é, portanto, aquele que mede corretamente a associação (positiva, negativa ou ausente) entre uma exposição e uma doença. Ele descreve a direção e a magnitude de um risco real. Dois tipos de validade são distinguidos: validade interna e validade externa. A validade interna é a capacidade de um estudo refletir o que realmente aconteceu entre os sujeitos do estudo; a validade externa reflete o que poderia ocorrer na população.

A validade está relacionada com a veracidade de uma medição. A validade deve ser diferenciada da precisão da medida, que é uma função do tamanho do estudo e da eficiência do desenho do estudo.

Validade interna

Diz-se que um estudo é internamente válido quando está livre de vieses e, portanto, reflete verdadeiramente a associação entre exposição e doença existente entre os participantes do estudo. Um risco de doença observado em associação com uma exposição pode de fato resultar de uma associação real e, portanto, ser válido, mas também pode refletir a influência de vieses. Um viés dará uma imagem distorcida da realidade.

Três tipos principais de preconceitos, também chamados erros sistemáticos, são geralmente distinguidos:

- viés de seleção

- viés de informação ou observação

- confuso

Eles serão apresentados brevemente abaixo, usando exemplos do ambiente de saúde ocupacional.

Viés de seleção

O viés de seleção ocorrerá quando a entrada no estudo for influenciada pelo conhecimento do status de exposição do potencial participante do estudo. Este problema é, portanto, encontrado apenas quando a doença já ocorreu no momento (antes) da pessoa entrar no estudo. Normalmente, no cenário epidemiológico, isso acontecerá em estudos de caso-controle ou em estudos de coorte retrospectivos. Isso significa que uma pessoa terá mais chances de ser considerada um caso se souber que ela foi exposta. Três conjuntos de circunstâncias podem levar a tal evento, que também dependerá da gravidade da doença.

Viés de auto-seleção

Isso pode ocorrer quando as pessoas que sabem que foram expostas a produtos nocivos conhecidos ou considerados nocivos no passado e que estão convencidas de que sua doença é o resultado da exposição consultarão um médico para sintomas que outras pessoas, não tão expostas, podem ter ignorado. Isso é particularmente provável de acontecer para doenças que apresentam poucos sintomas perceptíveis. Um exemplo pode ser a perda precoce da gravidez ou o aborto espontâneo entre enfermeiras que lidam com drogas usadas no tratamento do câncer. Essas mulheres estão mais conscientes do que a maioria da fisiologia reprodutiva e, por estarem preocupadas com sua capacidade de ter filhos, podem ser mais propensas a reconhecer ou rotular como aborto espontâneo o que outras mulheres considerariam apenas como um atraso no início da menstruação. Outro exemplo de um estudo de coorte retrospectivo, citado por Rothman (1986), envolve um estudo do Centro de Controle de Doenças sobre leucemia entre soldados que estiveram presentes durante um teste atômico dos Estados Unidos em Nevada. Das tropas presentes no local de teste, 76% foram rastreadas e constituíram a coorte. Destes, 82% foram encontrados pelos investigadores, mas outros 18% contataram os próprios investigadores depois de ouvir a publicidade sobre o estudo. Quatro casos de leucemia estavam presentes entre os 82% rastreados pelo CDC e quatro casos estavam presentes entre os 18% autorreferidos. Isso sugere fortemente que a capacidade dos investigadores de identificar pessoas expostas estava ligada ao risco de leucemia.

Viés de diagnóstico

Isso ocorrerá quando os médicos estiverem mais propensos a diagnosticar uma determinada doença, uma vez que sabem a que o paciente foi exposto anteriormente. Por exemplo, quando a maioria das tintas era à base de chumbo, um sintoma de doença dos nervos periféricos chamado neurite periférica com paralisia também era conhecido como “pulso caído” dos pintores. Conhecer a ocupação do paciente facilitou o diagnóstico da doença mesmo em seus estágios iniciais, enquanto a identificação do agente causal seria muito mais difícil em participantes da pesquisa sem exposição ocupacional conhecida ao chumbo.

Viés resultante da recusa em participar de um estudo

Quando as pessoas, saudáveis ou doentes, são convidadas a participar de um estudo, vários fatores desempenham um papel para determinar se elas concordarão ou não. A disposição para responder a questionários variavelmente longos, que às vezes indagam sobre questões delicadas, e ainda mais para doar sangue ou outras amostras biológicas, pode ser determinada pelo grau de interesse próprio da pessoa. Alguém que tenha conhecimento de uma exposição potencial passada pode estar disposto a aceitar este inquérito na esperança de que ajude a encontrar a causa da doença, enquanto alguém que considere não ter sido exposto a nada perigoso, ou que não esteja interessado em saber, pode recusar o convite para participar do estudo. Isso pode levar a uma seleção das pessoas que finalmente serão os participantes do estudo em comparação com todos aqueles que poderiam ter sido.

Viés de informação

Isso também é chamado de viés de observação e diz respeito ao resultado da doença em estudos de acompanhamento e avaliação de exposição em estudos de caso-controle.

Avaliação de resultados diferenciais em estudos prospectivos de acompanhamento (coorte)

Dois grupos são definidos no início do estudo: um grupo exposto e um grupo não exposto. Surgirão problemas de viés diagnóstico se a busca de casos diferir entre esses dois grupos. Por exemplo, considere um grupo de pessoas expostas a uma liberação acidental de dioxina em uma determinada indústria. Para o grupo altamente exposto, um sistema de acompanhamento ativo é estabelecido com exames médicos e monitoramento biológico em intervalos regulares, enquanto o restante da população trabalhadora recebe apenas cuidados de rotina. É altamente provável que mais doenças sejam identificadas no grupo sob vigilância rigorosa, o que levaria a uma potencial superestimação do risco.

Perdas diferenciais em estudos de coorte retrospectivos

O mecanismo inverso ao descrito no parágrafo anterior pode ocorrer em estudos de coorte retrospectivos. Nesses estudos, a maneira usual de proceder é começar com os arquivos de todas as pessoas que trabalharam em uma determinada indústria no passado e avaliar doenças ou mortalidade subseqüentes ao emprego. Infelizmente, em quase todos os estudos, os arquivos estão incompletos, e o fato de uma pessoa estar desaparecida pode estar relacionado ao estado de exposição, ao estado de doença ou a ambos. Por exemplo, em um estudo recente realizado na indústria química em trabalhadores expostos a aminas aromáticas, foram encontrados oito tumores em um grupo de 777 trabalhadores submetidos a triagem citológica de tumores urinários. Ao todo, apenas 34 registros foram encontrados ausentes, correspondendo a uma perda de 4.4% do arquivo de avaliação de exposição, mas para os casos de câncer de bexiga, os dados de exposição estavam ausentes em dois casos em oito, ou 25%. Isso mostra que os arquivos de pessoas que se tornaram casos eram mais propensos a se perder do que os arquivos de outros trabalhadores. Isso pode ocorrer devido a mudanças de cargo mais frequentes dentro da empresa (que podem estar ligadas a efeitos de exposição), pedido de demissão, demissão ou mero acaso.

Avaliação diferencial da exposição em estudos de caso-controle

Em estudos de caso-controle, a doença já ocorreu no início do estudo e serão buscadas informações sobre exposições no passado. O viés pode resultar da atitude do entrevistador ou do participante do estudo em relação à investigação. As informações geralmente são coletadas por entrevistadores treinados que podem ou não estar cientes da hipótese subjacente à pesquisa. Por exemplo, em um estudo de caso-controle populacional de câncer de bexiga realizado em uma região altamente industrializada, a equipe do estudo pode estar ciente do fato de que certos produtos químicos, como aminas aromáticas, são fatores de risco para câncer de bexiga. Se eles também souberem quem desenvolveu a doença e quem não a desenvolveu, provavelmente conduzirão entrevistas mais aprofundadas com os participantes que têm câncer de bexiga do que com os controles. Eles podem insistir em informações mais detalhadas sobre ocupações passadas, buscando sistematicamente a exposição a aminas aromáticas, enquanto que, para os controles, podem registrar ocupações de maneira mais rotineira. O viés resultante é conhecido como viés de suspeita de exposição.

Os próprios participantes também podem ser responsáveis por tal viés. Isso é chamado viés de recordação para distingui-lo do viés do entrevistador. Ambos têm suspeita de exposição como mecanismo para o viés. As pessoas doentes podem suspeitar de uma origem ocupacional para sua doença e, portanto, tentarão lembrar com a maior precisão possível todos os agentes perigosos aos quais possam ter sido expostos. No caso de manipulação de produtos indefinidos, eles podem estar inclinados a lembrar os nomes de produtos químicos precisos, especialmente se uma lista de produtos suspeitos for disponibilizada a eles. Por outro lado, os controles podem ter menos probabilidade de passar pelo mesmo processo de pensamento.

Confundindo

A confusão existe quando a associação observada entre exposição e doença é em parte o resultado de uma mistura do efeito da exposição em estudo e outro fator. Digamos, por exemplo, que estamos encontrando um risco aumentado de câncer de pulmão entre os soldadores. Somos tentados a concluir imediatamente que existe uma associação causal entre a exposição aos fumos de soldagem e o câncer de pulmão. No entanto, também sabemos que fumar é de longe o principal fator de risco para o câncer de pulmão. Portanto, se houver informações disponíveis, começamos a verificar o status de fumante dos soldadores e outros participantes do estudo. Podemos descobrir que os soldadores são mais propensos a fumar do que os não soldadores. Nessa situação, sabe-se que fumar está associado ao câncer de pulmão e, ao mesmo tempo, em nosso estudo, o tabagismo também está associado a ser soldador. Em termos epidemiológicos, isso significa que o tabagismo, associado tanto ao câncer de pulmão quanto à soldagem, está confundindo a associação entre soldagem e câncer de pulmão.

Modificação de interação ou efeito

Em contraste com todas as questões listadas acima, ou seja, seleção, informação e confusão, que são vieses, a interação não é um viés devido a problemas no desenho ou análise do estudo, mas reflete a realidade e sua complexidade. Um exemplo desse fenômeno é o seguinte: a exposição ao radônio é um fator de risco para o câncer de pulmão, assim como o tabagismo. Além disso, o fumo e a exposição ao radônio têm efeitos diferentes no risco de câncer de pulmão, dependendo se atuam em conjunto ou isoladamente. A maioria dos estudos ocupacionais sobre esse tópico foi realizada entre mineradores subterrâneos e, às vezes, forneceu resultados conflitantes. No geral, parece haver argumentos a favor de uma interação do fumo e da exposição ao radônio na produção de câncer de pulmão. Isso significa que o risco de câncer de pulmão é aumentado pela exposição ao radônio, mesmo em não fumantes, mas que o tamanho do aumento do risco do radônio é muito maior entre os fumantes do que entre os não fumantes. Em termos epidemiológicos, dizemos que o efeito é multiplicativo. Em contraste com a confusão, descrita acima, a interação precisa ser cuidadosamente analisada e descrita na análise, em vez de simplesmente controlada, pois reflete o que está acontecendo no nível biológico e não é apenas uma consequência de um desenho de estudo ruim. Sua explicação leva a uma interpretação mais válida dos resultados de um estudo.

Validade externa

Esse problema pode ser resolvido somente depois de garantir que a validade interna seja garantida. Se estivermos convencidos de que os resultados observados no estudo refletem associações reais, podemos nos perguntar se podemos ou não extrapolar esses resultados para a população maior da qual os próprios participantes do estudo foram retirados, ou mesmo para outras populações idênticas ou pelo menos muito semelhantes. A dúvida mais comum é se os resultados obtidos para os homens também se aplicam às mulheres. Durante anos, os estudos e, em particular, as investigações epidemiológicas ocupacionais foram realizados exclusivamente entre os homens. Estudos entre químicos realizados nas décadas de 1960 e 1970 nos Estados Unidos, Reino Unido e Suécia encontraram riscos aumentados de cânceres específicos, como leucemia, linfoma e câncer pancreático. Com base no que sabíamos sobre os efeitos da exposição a solventes e alguns outros produtos químicos, já poderíamos ter deduzido na época que o trabalho de laboratório também acarretava risco cancerígeno para as mulheres. Isso, de fato, foi demonstrado quando o primeiro estudo entre mulheres químicas foi finalmente publicado em meados da década de 1980, que encontrou resultados semelhantes aos dos homens. Vale a pena notar que outros cânceres em excesso encontrados foram tumores de mama e ovário, tradicionalmente considerados relacionados apenas a fatores endógenos ou à reprodução, mas para os quais fatores ambientais recém-suspeitados, como pesticidas, podem desempenhar um papel. Muito mais trabalho precisa ser feito sobre os determinantes ocupacionais dos cânceres femininos.

Estratégias para um Estudo Válido

Um estudo perfeitamente válido nunca pode existir, mas cabe ao pesquisador tentar evitar, ou pelo menos minimizar, tantos vieses quanto possível. Muitas vezes, isso pode ser feito melhor no estágio de projeto do estudo, mas também pode ser realizado durante a análise.

Desenho do estudo

O viés de seleção e informação só pode ser evitado por meio de um desenho cuidadoso de um estudo epidemiológico e da implementação escrupulosa de todas as diretrizes do dia a dia, incluindo atenção meticulosa à garantia de qualidade, para a condução do estudo em condições de campo. A confusão pode ser tratada no estágio de projeto ou análise.

Seleção

Os critérios para considerar um participante como um caso devem ser explicitamente definidos. Não se pode, ou pelo menos não se deve, tentar estudar condições clínicas mal definidas. Uma forma de minimizar o impacto que o conhecimento da exposição pode ter na avaliação da doença é incluir apenas casos graves que teriam sido diagnosticados independentemente de qualquer informação sobre a história do paciente. No campo do câncer, os estudos muitas vezes serão limitados a casos com comprovação histológica da doença para evitar a inclusão de lesões limítrofes. Isso também significa que os grupos em estudo estão bem definidos. Por exemplo, é bem conhecido na epidemiologia do câncer que cânceres de diferentes tipos histológicos dentro de um determinado órgão podem ter fatores de risco diferentes. Se o número de casos for suficiente, é melhor separar o adenocarcinoma do pulmão do carcinoma de células escamosas do pulmão. Quaisquer que sejam os critérios finais para entrada no estudo, eles devem sempre ser claramente definidos e descritos. Por exemplo, o código exato da doença deve ser indicado usando a Classificação Internacional de Doenças (CID) e também, para o câncer, a Classificação Internacional de Doenças-Oncologia (CID-O).

Esforços devem ser feitos uma vez que os critérios são especificados para maximizar a participação no estudo. A decisão de se recusar a participar raramente é feita ao acaso e, portanto, leva ao viés. Os estudos devem, antes de tudo, ser apresentados aos médicos que estão atendendo os pacientes. Sua aprovação é necessária para abordar os pacientes e, portanto, eles terão que ser convencidos a apoiar o estudo. Um argumento que costuma ser persuasivo é que o estudo é do interesse da saúde pública. No entanto, nesta fase, é melhor não discutir a hipótese exata que está sendo avaliada, a fim de evitar influenciar indevidamente os médicos envolvidos. Não se deve pedir aos médicos que assumam funções suplementares; é mais fácil convencer o pessoal de saúde a apoiar um estudo se os investigadores do estudo fornecerem meios para realizar quaisquer tarefas adicionais, além dos cuidados de rotina, exigidas pelo estudo. Os entrevistadores e coletores de dados devem desconhecer o estado da doença de seus pacientes.

Atenção semelhante deve ser dada às informações fornecidas aos participantes. O objetivo do estudo deve ser descrito em termos amplos e neutros, mas também deve ser convincente e persuasivo. É importante que as questões de confidencialidade e interesse para a saúde pública sejam totalmente compreendidas, evitando o jargão médico. Na maioria das configurações, o uso de incentivos financeiros ou outros não é considerado apropriado, embora deva ser fornecida uma compensação por qualquer despesa que um participante possa incorrer. Por último, mas não menos importante, a população em geral deve ser suficientemente alfabetizada cientificamente para entender a importância de tal pesquisa. Tanto os benefícios quanto os riscos da participação devem ser explicados a cada participante potencial quando eles precisarem preencher questionários e/ou fornecer amostras biológicas para armazenamento e/ou análise. Nenhuma coerção deve ser aplicada na obtenção de consentimento prévio e totalmente informado. Quando os estudos são exclusivamente baseados em registros, deve ser garantida a aprovação prévia dos órgãos responsáveis por garantir a confidencialidade de tais registros. Nesses casos, o consentimento do participante individual geralmente pode ser dispensado. Em vez disso, a aprovação do sindicato e dos funcionários do governo será suficiente. As investigações epidemiológicas não são uma ameaça à vida privada de um indivíduo, mas um auxílio potencial para melhorar a saúde da população. A aprovação de um conselho de revisão institucional (ou comitê de revisão ética) será necessária antes da realização de um estudo, e muito do que foi declarado acima será esperado por eles para sua revisão.

Dados Pessoais

Em estudos prospectivos de acompanhamento, os meios para avaliação da doença ou do estado de mortalidade devem ser idênticos para participantes expostos e não expostos. Em particular, fontes diferentes não devem ser usadas, como apenas verificar em um registro central de mortalidade para participantes não expostos e usar vigilância ativa intensiva para participantes expostos. Da mesma forma, a causa da morte deve ser obtida de maneiras estritamente comparáveis. Isso significa que se for utilizado um sistema de acesso a documentos oficiais para a população não exposta, que muitas vezes é a população em geral, nunca se deve planejar obter informações ainda mais precisas por meio de prontuários ou entrevistas dos próprios participantes ou de seus familiares para o subgrupo exposto.

Em estudos de coorte retrospectivos, esforços devem ser feitos para determinar quão próxima a população em estudo é comparada à população de interesse. Deve-se ter cuidado com possíveis perdas diferenciais em grupos expostos e não expostos, usando várias fontes sobre a composição da população. Por exemplo, pode ser útil comparar listas de folha de pagamento com listas de filiação sindical ou outras listas profissionais. As discrepâncias devem ser conciliadas e o protocolo adotado para o estudo deve ser rigorosamente seguido.

Em estudos de caso-controle, existem outras opções para evitar vieses. Os entrevistadores, a equipe do estudo e os participantes do estudo não precisam estar cientes da hipótese precisa em estudo. Se eles não conhecem a associação que está sendo testada, é menos provável que tentem fornecer a resposta esperada. Manter o pessoal do estudo no escuro quanto à hipótese de pesquisa é, de fato, muitas vezes muito impraticável. O entrevistador quase sempre saberá as exposições de maior interesse potencial, bem como quem é um caso e quem é um controle. Devemos, portanto, contar com sua honestidade e também com sua formação em metodologia de pesquisa básica, que deve fazer parte de sua formação profissional; a objetividade é a marca registrada em todos os estágios da ciência.

É mais fácil não informar os participantes do estudo sobre o objeto exato da pesquisa. Boas explicações básicas sobre a necessidade de coletar dados para uma melhor compreensão da saúde e da doença geralmente são suficientes e satisfarão as necessidades da revisão ética.

Confundindo

A confusão é o único viés que pode ser tratado no estágio de desenho do estudo ou, desde que informações adequadas estejam disponíveis, no estágio de análise. Se, por exemplo, a idade for considerada um potencial confundidor da associação de interesse porque a idade está associada ao risco de doença (ou seja, o câncer se torna mais frequente em idades mais avançadas) e também à exposição (as condições de exposição variam com a idade ou com fatores relacionados à idade, como qualificação, cargo e tempo de emprego), existem várias soluções. O mais simples é limitar o estudo a uma faixa etária específica - por exemplo, inscrever apenas homens caucasianos de 40 a 50 anos. Isso fornecerá elementos para uma análise simples, mas também terá a desvantagem de limitar a aplicação dos resultados a um único sexo idade/grupo racial. Outra solução é a correspondência por idade. Isso significa que, para cada caso, é necessário um referente da mesma idade. Essa é uma ideia atraente, mas deve-se ter em mente a possível dificuldade de atender a esse requisito à medida que o número de fatores de correspondência aumenta. Além disso, uma vez que um fator tenha sido pareado, torna-se impossível avaliar seu papel na ocorrência da doença. A última solução é ter informações suficientes sobre potenciais fatores de confusão no banco de dados do estudo para verificá-los na análise. Isso pode ser feito por meio de uma análise estratificada simples ou com ferramentas mais sofisticadas, como a análise multivariada. No entanto, deve-se lembrar que a análise nunca será capaz de compensar um estudo mal planejado ou mal conduzido.

Conclusão

O potencial de ocorrência de vieses na pesquisa epidemiológica está estabelecido há muito tempo. Isso não era muito preocupante quando as associações estudadas eram fortes (como é o caso do tabagismo e do câncer de pulmão) e, portanto, alguma imprecisão não causava um problema muito grave. No entanto, agora que chegou a hora de avaliar fatores de risco mais fracos, a necessidade de melhores ferramentas torna-se fundamental. Isso inclui a necessidade de excelentes designs de estudo e a possibilidade de combinar as vantagens de vários designs tradicionais, como os estudos de caso-controle ou coorte, com abordagens mais inovadoras, como estudos de caso-controle aninhados em uma coorte. Além disso, o uso de biomarcadores pode fornecer os meios para obter avaliações mais precisas de exposições atuais e possivelmente passadas, bem como para os estágios iniciais da doença.

Fadiga e Recuperação

Fadiga e recuperação são processos periódicos em todos os organismos vivos. A fadiga pode ser descrita como um estado caracterizado por uma sensação de cansaço combinada com uma redução ou variação indesejada no desempenho da atividade (Rohmert 1973).

Nem todas as funções do organismo humano se cansam com o uso. Mesmo dormindo, por exemplo, respiramos e nosso coração bate sem parar. Obviamente, as funções básicas de respiração e atividade cardíaca são possíveis ao longo da vida sem fadiga e sem pausas para recuperação.

Por outro lado, depois de um trabalho pesado bastante prolongado, verificamos que há uma redução na capacidade – que chamamos de fadiga. Isso não se aplica apenas à atividade muscular. Os órgãos sensoriais ou os centros nervosos também ficam cansados. É, no entanto, o objetivo de cada célula equilibrar a capacidade perdida por sua atividade, um processo que chamamos de recuperação.

Estresse, tensão, fadiga e recuperação

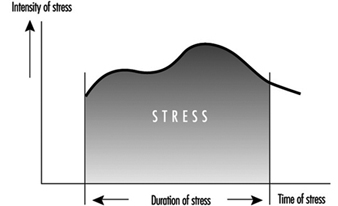

Os conceitos de fadiga e recuperação no trabalho humano estão intimamente relacionados aos conceitos ergonômicos de estresse e tensão (Rohmert 1984) (figura 1).

Figura 1. Estresse, tensão e fadiga

Estresse significa a soma de todos os parâmetros de trabalho no sistema de trabalho que influenciam as pessoas no trabalho, que são percebidos ou sentidos principalmente no sistema receptor ou que colocam demandas no sistema efetor. Os parâmetros de estresse resultam da tarefa de trabalho (trabalho muscular, trabalho não muscular - dimensões e fatores orientados para a tarefa) e das condições físicas, químicas e sociais sob as quais o trabalho deve ser realizado (ruído, clima, iluminação, vibração , trabalho por turnos, etc.—dimensões e fatores orientados para a situação).

A intensidade/dificuldade, a duração e a composição (ou seja, a distribuição simultânea e sucessiva dessas demandas específicas) dos fatores de estresse resultam em estresse combinado, que todos os efeitos exógenos de um sistema de trabalho exercem sobre a pessoa que trabalha. Este estresse combinado pode ser enfrentado ativamente ou passivamente, dependendo especificamente do comportamento da pessoa que trabalha. O caso ativo envolverá atividades voltadas para a eficiência do sistema de trabalho, enquanto o caso passivo induzirá reações (voluntárias ou involuntárias), que se preocupam principalmente com a minimização do estresse. A relação entre o estresse e a atividade é influenciada decisivamente pelas características e necessidades individuais do trabalhador. Os principais fatores de influência são os que determinam o desempenho e estão relacionados à motivação e concentração e os relacionados à disposição, que podem ser referidos como habilidades e habilidades.

As tensões relevantes para o comportamento, que se manifestam em certas atividades, causam tensões individualmente diferentes. As tensões podem ser indicadas pela reação de indicadores fisiológicos ou bioquímicos (por exemplo, aumento da frequência cardíaca) ou podem ser percebidas. Assim, as tensões são suscetíveis de “escalonamento psicofísico”, que estima a tensão experimentada pelo trabalhador. Em uma abordagem comportamental, a existência de tensão também pode ser derivada de uma análise de atividade. A intensidade com que os indicadores de tensão (fisiológico-bioquímico, comportamental ou psicofísico) reagem depende da intensidade, duração e combinação de fatores de estresse, bem como das características individuais, habilidades, habilidades e necessidades da pessoa que trabalha.

Apesar das tensões constantes, os indicadores derivados dos campos de atividade, desempenho e tensão podem variar ao longo do tempo (efeito temporal). Tais variações temporais devem ser interpretadas como processos de adaptação dos sistemas orgânicos. Os efeitos positivos causam redução do esforço/melhoria da atividade ou desempenho (por exemplo, por meio de treinamento). No caso negativo, no entanto, eles resultarão em aumento da tensão/redução da atividade ou desempenho (por exemplo, fadiga, monotonia).

Os efeitos positivos podem entrar em ação se as habilidades e habilidades disponíveis forem aprimoradas no próprio processo de trabalho, por exemplo, quando o limite de estimulação do treinamento for ligeiramente excedido. Os efeitos negativos provavelmente aparecerão se os chamados limites de resistência (Rohmert 1984) forem excedidos no decorrer do processo de trabalho. Essa fadiga leva a uma redução das funções fisiológicas e psicológicas, que podem ser compensadas pela recuperação.

Para restaurar o desempenho original, são necessários períodos de descanso ou pelo menos períodos com menos estresse (Luczak 1993).

Quando o processo de adaptação é levado além de limites definidos, o sistema orgânico empregado pode ser danificado de forma a causar uma deficiência parcial ou total de suas funções. Uma redução irreversível das funções pode ocorrer quando o estresse é muito alto (dano agudo) ou quando a recuperação é impossível por mais tempo (dano crônico). Um exemplo típico de tal dano é a perda auditiva induzida por ruído.

Modelos de Fadiga

A fadiga pode ser multifacetada, dependendo da forma e combinação de tensão, e uma definição geral dela ainda não é possível. Os processos biológicos da fadiga em geral não são mensuráveis de forma direta, de modo que as definições se orientam principalmente para os sintomas de fadiga. Esses sintomas de fadiga podem ser divididos, por exemplo, nas três categorias a seguir.

- Sintomas fisiológicos: a fadiga é interpretada como uma diminuição das funções dos órgãos ou de todo o organismo. Isso resulta em reações fisiológicas, por exemplo, em um aumento da freqüência cardíaca ou da atividade muscular elétrica (Laurig 1970).

- sintomas comportamentais: a fadiga é interpretada principalmente como uma diminuição dos parâmetros de desempenho. Exemplos são erros crescentes ao resolver certas tarefas ou uma variabilidade crescente de desempenho.

- Sintomas psicofísicos: a fadiga é interpretada como um aumento da sensação de esforço e deterioração da sensação, dependendo da intensidade, duração e composição dos fatores de estresse.

No processo de fadiga, todos esses três sintomas podem desempenhar um papel, mas podem aparecer em momentos diferentes.

As reações fisiológicas em sistemas orgânicos, particularmente os envolvidos no trabalho, podem aparecer primeiro. Mais tarde, a sensação de esforço pode ser afetada. As mudanças no desempenho se manifestam geralmente em uma regularidade de trabalho decrescente ou em uma quantidade crescente de erros, embora a média do desempenho ainda não seja afetada. Pelo contrário, com motivação adequada, o trabalhador pode até tentar manter o desempenho por meio da força de vontade. O próximo passo pode ser uma clara redução de desempenho, terminando com uma quebra de desempenho. Os sintomas fisiológicos podem levar a um colapso do organismo, incluindo mudanças na estrutura da personalidade e exaustão. O processo de fadiga é explicado na teoria da desestabilização sucessiva (Luczak 1983).

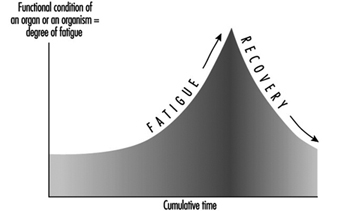

A principal tendência de fadiga e recuperação é mostrada na figura 2.

Figura 2. Tendência principal de fadiga e recuperação

Prognóstico de Fadiga e Recuperação

No campo da ergonomia há um interesse especial em prever a fadiga dependente da intensidade, duração e composição dos fatores de estresse e determinar o tempo de recuperação necessário. A Tabela 1 mostra esses diferentes níveis de atividade e períodos de consideração e possíveis motivos de fadiga e diferentes possibilidades de recuperação.

Tabela 1. Fadiga e recuperação dependentes dos níveis de atividade

|

Nível de atividade |

de Payback |

Fadiga de |

Recuperação por |

|

Vida de trabalho |

Décadas |

esforço excessivo para |

Aposentadoria |

|

Fases da vida profissional |

Anos |

esforço excessivo para |

Férias |

|

Seqüências de |

Meses/semanas |

Mudança desfavorável |

Fim de semana, grátis |

|

Um turno de trabalho |

Um dia |

Estresse acima |

Tempo livre, descanso |

|

tarefas |

horas |

Estresse acima |

Período de descanso |

|

Parte de uma tarefa |

Minutos |

Estresse acima |

Mudança de estresse |

Na análise ergonômica de estresse e fadiga para determinar o tempo de recuperação necessário, considerar o período de um dia de trabalho é o mais importante. Os métodos de tais análises começam com a determinação dos diferentes fatores de estresse em função do tempo (Laurig 1992) (figura 3).

Figura 3. Estresse em função do tempo

Os fatores de estresse são determinados a partir do conteúdo específico do trabalho e das condições de trabalho. O conteúdo do trabalho pode ser a produção de força (p. para produzir informações (por exemplo, ao programar, traduzir) e a produção de informações (por exemplo, ao projetar, resolver problemas). As condições de trabalho incluem aspectos físicos (por exemplo, ruído, vibração, calor), químicos (agentes químicos) e sociais (por exemplo, colegas, trabalho em turnos).

No caso mais fácil, haverá um único fator de estresse importante, enquanto os outros podem ser negligenciados. Nesses casos, principalmente quando os fatores de estresse resultam do trabalho muscular, muitas vezes é possível calcular os intervalos de descanso necessários, pois os conceitos básicos são conhecidos.

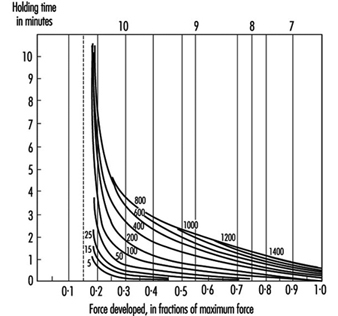

Por exemplo, o descanso suficiente permitido no trabalho muscular estático depende da força e duração da contração muscular como em uma função exponencial vinculada pela multiplicação de acordo com a fórmula:

![]()

de

RA = Subsídio de descanso em porcentagem de t

t = duração da contração (período de trabalho) em minutos

T = duração máxima possível da contração em minutos

f = a força necessária para a força estática e

F = força máxima.

A conexão entre força, tempo de espera e permissão de descanso é mostrada na figura 4.

Figura 4. Porcentagens de descanso permitidas para várias combinações de forças de retenção e tempo

Existem leis semelhantes para trabalho muscular dinâmico pesado (Rohmert 1962), trabalho muscular leve ativo (Laurig 1974) ou trabalho muscular industrial diferente (Schmidtke 1971). Mais raramente você encontra leis comparáveis para trabalho não-físico, por exemplo, para computação (Schmidtke 1965). Uma visão geral dos métodos existentes para determinar as tolerâncias de descanso principalmente para trabalho muscular e não muscular isolado é dada por Laurig (1981) e Luczak (1982).

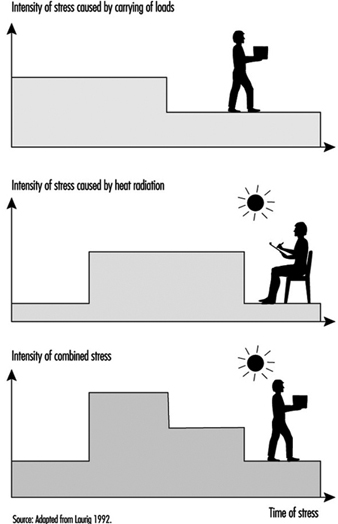

Mais difícil é a situação em que existe uma combinação de diferentes fatores de estresse, conforme mostrado na figura 5, que afetam a pessoa que trabalha simultaneamente (Laurig 1992).

Figura 5. A combinação de dois fatores de estresse

A combinação de dois fatores de tensão, por exemplo, pode levar a diferentes reações de deformação dependendo das leis de combinação. O efeito combinado de diferentes fatores de estresse pode ser indiferente, compensatório ou cumulativo.

No caso de leis de combinação indiferentes, os diferentes fatores de estresse afetam diferentes subsistemas do organismo. Cada um desses subsistemas pode compensar a tensão sem que a tensão seja alimentada em um subsistema comum. A deformação geral depende do fator de tensão mais alto e, portanto, as leis de superposição não são necessárias.

Um efeito compensatório é dado quando a combinação de diferentes fatores de estresse leva a uma tensão menor do que cada fator de estresse sozinho. A combinação de trabalho muscular e baixas temperaturas pode reduzir o esforço geral, pois as baixas temperaturas permitem que o corpo perca o calor produzido pelo trabalho muscular.

Um efeito cumulativo surge se vários fatores de estresse são sobrepostos, ou seja, eles devem passar por um “gargalo” fisiológico. Um exemplo é a combinação de trabalho muscular e estresse térmico. Ambos os fatores de estresse afetam o sistema circulatório como um gargalo comum com tensão cumulativa resultante.

Possíveis efeitos de combinação entre trabalho muscular e condições físicas são descritos em Bruder (1993) (ver tabela 2).

Tabela 2. Regras de efeitos de combinação de dois fatores de tensão na deformação

|

Frio |

vibração |

Iluminação |

Ruído |

|

|

Trabalho dinâmico pesado |

- |

+ |

0 |

0 |

|

Trabalho muscular leve ativo |

+ |

+ |

0 |

0 |

|

Trabalho muscular estático |

+ |

+ |

0 |

0 |

0 efeito indiferente; + efeito cumulativo; – efeito compensatório.

Fonte: Adaptado de Bruder 1993.

Para o caso da combinação de mais de dois fatores de estresse, que é a situação normal na prática, apenas um conhecimento científico limitado está disponível. O mesmo se aplica à combinação sucessiva de fatores de estresse (ou seja, o efeito de tensão de diferentes fatores de estresse que afetam o trabalhador sucessivamente). Para tais casos, na prática, o tempo de recuperação necessário é determinado medindo parâmetros fisiológicos ou psicológicos e usando-os como valores integradores.

Impacto do erro de medição aleatória

Os erros na medição da exposição podem ter diferentes impactos na relação exposição-doença em estudo, dependendo de como os erros são distribuídos. Se um estudo epidemiológico foi conduzido às cegas (ou seja, as medições foram feitas sem conhecimento da doença ou estado de saúde dos participantes do estudo), esperamos que o erro de medição seja distribuído uniformemente entre os estratos de doença ou estado de saúde.

A Tabela 1 fornece um exemplo: suponha que recrutamos uma coorte de pessoas expostas no trabalho a um tóxico, a fim de investigar uma doença frequente. Determinamos o status de exposição apenas no recrutamento (T0), e não em outros pontos no tempo durante o acompanhamento. No entanto, digamos que alguns indivíduos, de fato, mudem seu status de exposição no ano seguinte: no tempo T1, 250 das 1,200 pessoas expostas originais deixaram de ser expostas, enquanto 150 das 750 pessoas não expostas originais passaram a ser expostas ao tóxico. Portanto, no tempo T1, 1,100 indivíduos estão expostos e 850 não estão expostos. Como consequência, temos “classificação incorreta” de exposição, com base em nossa medição inicial do status de exposição no tempo T0. Esses indivíduos são então rastreados após 20 anos (no tempo T2) e avalia-se o risco cumulativo de doença. (A suposição feita no exemplo é que apenas a exposição de mais de um ano é uma preocupação.)

Tabela 1. Coorte hipotética de 1950 indivíduos (expostos e não expostos ao trabalho), recrutados no tempo T0 e cujo estado de doença é verificado no tempo T2

|

Horário |

|||

|

T0 |

T1 |

T2 |

|

Trabalhadores expostos 1200 250 abandonam a exposição 1100 (1200-250+150)

Casos de doença no tempo T2 = 220 entre trabalhadores expostos

Trabalhadores não expostos 750 150 exposição inicial 850 (750-150+250)

Casos de doença no tempo T2 = 85 entre trabalhadores não expostos

A risco verdadeiro da doença no tempo T2 é de 20% entre os trabalhadores expostos (220/1100),

e 10% em trabalhadores não expostos (85/850) (razão de risco = 2.0).

Risco estimado em T2 da doença entre aqueles classificados como expostos em T0: 20%

(ou seja, risco verdadeiro nos expostos) ´ 950 (ou seja, 1200-250)+ 10%

(ou seja, risco verdadeiro em não expostos) ´ 250 = (190+25)/1200 = 17.9%

Risco estimado em T2 de doença entre aqueles classificados como não expostos em

T0: 20% (ou seja, risco verdadeiro nos expostos) ´ 150 +10%

(ou seja, risco verdadeiro em não expostos) ´ 600 (ou seja, 750-150) = (30+60)/750 = 12%

Taxa de risco estimada = 17.9% / 12% = 1.49

A classificação incorreta depende, neste exemplo, do desenho do estudo e das características da população, e não das limitações técnicas da medição da exposição. O efeito da classificação incorreta é tal que a razão “verdadeira” de 2.0 entre o risco cumulativo entre pessoas expostas e não expostas torna-se uma razão “observada” de 1.49 (tabela 1). Essa subestimação da razão de risco decorre de uma “indefinição” da relação entre exposição e doença, que ocorre quando a classificação incorreta da exposição, como neste caso, é distribuída uniformemente de acordo com a doença ou estado de saúde (ou seja, a medição da exposição é não influenciada pelo fato de a pessoa sofrer ou não da doença que estamos estudando).

Por outro lado, pode ocorrer subestimação ou superestimação da associação de interesse quando a classificação incorreta da exposição não é distribuída uniformemente pelo resultado de interesse. No exemplo, podemos ter viés, e não apenas uma indefinição da relação etiológica, se a classificação da exposição depender da doença ou do estado de saúde dos trabalhadores. Isso pode ocorrer, por exemplo, se decidirmos coletar amostras biológicas de um grupo de trabalhadores expostos e de um grupo de trabalhadores não expostos, a fim de identificar precocemente alterações relacionadas à exposição no trabalho. As amostras dos trabalhadores expostos podem então ser analisadas de forma mais precisa do que as amostras dos não expostos; a curiosidade científica pode levar o pesquisador a medir biomarcadores adicionais entre as pessoas expostas (incluindo, por exemplo, adutos de DNA em linfócitos ou marcadores urinários de dano oxidativo ao DNA), na suposição de que essas pessoas são cientificamente “mais interessantes”. Esta é uma atitude bastante comum que, no entanto, pode levar a sérios vieses.

Métodos estatísticos

Há muito debate sobre o papel das estatísticas na pesquisa epidemiológica sobre relações causais. Em epidemiologia, a estatística é principalmente uma coleção de métodos para avaliar dados baseados em populações humanas (e também em animais). Em particular, a estatística é uma técnica para a quantificação e medição de fenômenos incertos. Todas as investigações científicas que lidam com aspectos não determinísticos e variáveis da realidade poderiam se beneficiar da metodologia estatística. Em epidemiologia, a variabilidade é intrínseca à unidade de observação – uma pessoa não é uma entidade determinística. Embora os projetos experimentais sejam melhorados em termos de atender melhor às suposições das estatísticas em termos de variação aleatória, por razões éticas e práticas, essa abordagem não é muito comum. Em vez disso, a epidemiologia está engajada na pesquisa observacional que tem associada a ela fontes aleatórias e outras fontes de variabilidade.

A teoria estatística está preocupada em como controlar a variabilidade não estruturada nos dados para fazer inferências válidas a partir de observações empíricas. Na falta de qualquer explicação para o comportamento variável do fenômeno estudado, a estatística o assume como acaso— isto é, desvios não sistemáticos de algum estado médio da natureza (ver Greenland 1990 para uma crítica dessas suposições).

A ciência depende da empiria evidência para demonstrar se seus modelos teóricos de eventos naturais têm alguma validade. De fato, os métodos usados da teoria estatística determinam o grau em que as observações no mundo real se conformam com a visão dos cientistas, em forma de modelo matemático, de um fenômeno. Métodos estatísticos, baseados em matemática, devem, portanto, ser cuidadosamente selecionados; há muitos exemplos sobre “como mentir com estatísticas”. Portanto, os epidemiologistas devem estar cientes da adequação das técnicas que aplicam para medir o risco de doença. Em particular, é necessário muito cuidado ao interpretar resultados estatisticamente significativos e estatisticamente não significativos.

O primeiro significado da palavra estatística refere-se a qualquer quantidade resumida calculada em um conjunto de valores. Índices descritivos ou estatísticas como a média aritmética, a mediana ou a moda são amplamente utilizados para resumir as informações em uma série de observações. Historicamente, esses descritores resumidos foram usados para fins administrativos pelos estados e, portanto, foram nomeados estatística. Em epidemiologia, as estatísticas comumente vistas derivam das comparações inerentes à natureza da epidemiologia, que faz perguntas como: “Uma população tem maior risco de doença do que outra?” Ao fazer tais comparações, o risco relativo é uma medida popular da força da associação entre uma característica individual e a probabilidade de adoecer, e é mais comumente aplicado na pesquisa etiológica; o risco atribuível também é uma medida de associação entre as características individuais e a ocorrência da doença, mas enfatiza o ganho em número de casos poupados por uma intervenção que remove o fator em questão – é aplicado principalmente em saúde pública e medicina preventiva.

O segundo significado da palavra estatística relaciona-se com a coleção de técnicas e a teoria subjacente de inferência estatística. Esta é uma forma particular de lógica indutiva que especifica as regras para obter uma generalização válida a partir de um conjunto particular de observações empíricas. Essa generalização seria válida desde que algumas suposições fossem atendidas. Esta é a segunda maneira pela qual um uso inculto da estatística pode nos enganar: na epidemiologia observacional, é muito difícil ter certeza das suposições implícitas nas técnicas estatísticas. Portanto, a análise de sensibilidade e os estimadores robustos devem ser companheiros de qualquer análise de dados conduzida corretamente. As conclusões finais também devem se basear no conhecimento geral e não devem depender exclusivamente das descobertas do teste de hipóteses estatísticas.

Definições

A unidade estatística é o elemento sobre o qual são feitas as observações empíricas. Pode ser uma pessoa, um espécime biológico ou um pedaço de matéria-prima a ser analisado. Normalmente, as unidades estatísticas são escolhidas independentemente pelo pesquisador, mas às vezes projetos mais complexos podem ser configurados. Por exemplo, em estudos longitudinais, uma série de determinações é feita em um conjunto de pessoas ao longo do tempo; as unidades estatísticas deste estudo são o conjunto de determinações, que não são independentes, mas estruturadas por suas respectivas conexões com cada sujeito estudado. A falta de independência ou correlação entre as unidades estatísticas merece atenção especial na análise estatística.

A variável é uma característica individual medida em uma determinada unidade estatística. Deve ser contrastado com um constante, uma característica individual fixa – por exemplo, em um estudo sobre seres humanos, ter cabeça ou tórax são constantes, enquanto o gênero de um único membro do estudo é uma variável.

As variáveis são avaliadas usando diferentes escalas de medida. A primeira distinção é entre escalas qualitativas e quantitativas. Variáveis qualitativas fornecem diferentes modalidades or Categorias. Se cada modalidade não pode ser classificada ou ordenada em relação a outras - por exemplo, cor de cabelo ou modalidades de gênero - denotamos a variável como nominal. Se as categorias puderem ser ordenadas – como o grau de gravidade de uma doença – a variável é chamada ordinal. Quando uma variável é constituída por um valor numérico, dizemos que a escala é quantitativa. UMA discreto escala denota que a variável pode assumir apenas alguns valores definidos - por exemplo, valores inteiros para o número de casos de doença. UMA contínuo escala é usada para aquelas medidas que resultam em reais números. As escalas contínuas são ditas intervalo escalas quando o valor nulo tem um significado puramente convencional. Ou seja, um valor zero não significa quantidade zero – por exemplo, uma temperatura de zero grau Celsius não significa energia térmica zero. Neste caso, apenas diferenças entre valores fazem sentido (esta é a razão do termo escala “intervalada”). Um valor nulo real denota um relação escala. Para uma variável medida nessa escala, razões de valores também fazem sentido: de fato, uma razão dupla significa o dobro da quantidade. Por exemplo, dizer que um corpo tem uma temperatura duas vezes maior que um segundo corpo significa que ele tem duas vezes a energia térmica do segundo corpo, providenciou que a temperatura é medida em uma escala proporcional (por exemplo, em graus Kelvin). O conjunto de valores permitidos para uma determinada variável é chamado de domínio da variável.

Paradigmas Estatísticos

A estatística lida com a maneira de generalizar a partir de um conjunto de observações particulares. Este conjunto de medidas empíricas é chamado de amostra. A partir de uma amostra, calculamos algumas estatísticas descritivas para resumir as informações coletadas.

A informação básica geralmente necessária para caracterizar um conjunto de medidas diz respeito à sua tendência central e à sua variabilidade. A escolha entre várias alternativas depende da escala usada para medir um fenômeno e dos propósitos para os quais as estatísticas são computadas. Na tabela 1 são descritas diferentes medidas de tendência central e variabilidade (ou, dispersão) associadas à escala de medida apropriada.